Se podrá obtener o recuperar la clave fiscal de la AFIP con el teléfono celular: el paso a paso

El procedimiento que deberán utilizar los contribuyentes desde la APP "Mi AFIP" requiere de tres simples pasos. Video

16 de mayo de 2019

La Administración Federal de Ingresos Públicos (AFIP) sumó a la App "Mi AFIP" un servicio para que los contribuyentes puedan obtener y recuperar la clave fiscal a través de la técnica de reconocimiento facial con cualquier teléfono celular que tenga cámara frontal y acceso a Internet.

El objetivo es ahorrarle tiempo a unas 60.000 personas por mes, que ya no deberán concurrir a las agencias de la AFIP a solicitar o recuperar sus claves, ya que ahora podrán hacerlo en forma digital.

Se trata de una aplicación móvil integrada a la App "Mi AFIP", que ya existe. Puede ser utilizada desde cualquier dispositivo móvil que cuente con una cámara frontal y tenga acceso a internet.

La AFIP modificó los niveles de seguridad para la obtención de la "Clave Fiscal"

El servicio está habilitado desde hoy tal como lo prevé la Resolución General 4486 publicada en el Boletín Oficial. En una primera etapa, solamente estará disponible para Android.

El procedimiento:

– Escanear el código de su DNI (tarjeta) para verificar su identidad.

– Capturar con la cámara del teléfono la imagen de su rostro en determinadas posiciones.

– Generar la clave fiscal, que será utilizada luego para la validación en la página web de la AFIP.

El futuro de la vigilancia es sobre los comportamientos, no las caras

Publicado por Melvecs

Debido a la falta de regulaciones y legislación, la vigilancia ubicua va mucho más allá de la simple identificación biométrica y ahora se centra en los comportamientos, incluido el análisis pre-crímen. Las expresiones faciales, los movimientos oculares, el andar, la respiración, etc., se aplican a los algoritmos de inteligencia artificial para detectar el estado de ánimo, la personalidad y las emociones.

En 1787, al filósofo inglés Jeremy Bentham se le ocurrió una idea para una prisión que costaría una fracción del costo de otras cárceles contemporáneas para que pudiera funcionar prácticamente sin crimen interno. Su prisión teórica, el panóptico, estaba curvada, con las celdas orientadas hacia el interior hacia un punto central donde se ubicaría una torre de guardia. Las ventanas de la torre de guardia debían oscurecerse en un lado. De esta manera, un solo guardia podría observar el comportamiento de todos los prisioneros. Pero lo que es más importante, los prisioneros nunca sabrían si el guardia tenía su mirada puesta sobre ellos. El resultado final, cada individuo dentro de la prisión internaliza la sensación de ser vigilado todo el tiempo y se comporta en consecuencia.

Esta idea del panóptico se ha convertido en un sustituto de la amenaza de la vigilancia ubicua, debido principalmente a la elección del lugar de Bentham: una prisión. Pero Bentham se propuso no asustar a las personas, sino proporcionar una manera de administrar un recurso escaso: la atención de las autoridades policiales.

Una nueva tendencia en la tecnología de videovigilancia está convirtiendo el panóptico de Bentham en realidad, pero no de la manera que él imaginó. En lugar de una prisión, el nuevo panóptico centrará la atención de las autoridades policiales en una persona cuando su comportamiento se vuelva relevante para la torre de guardia. Imagínese que fuera posible reconocer no las caras de las personas que ya habían cometido delitos, sino los comportamientos que indican un delito que estaba a punto de ocurrir.

Varios proveedores y nuevas empresas que asistieron a ISC West, una reciente conferencia sobre tecnología de seguridad en Las Vegas, buscaron atender un mercado en crecimiento para equipos de vigilancia y software que pueden encontrar armas ocultas, leer placas de matrículas y otros indicadores de identidad, e incluso descifrar el comportamiento humano.

Una compañía llamada ZeroEyes fuera de Filadelfia ofrece a los departamentos de policía un sistema que puede detectar cuándo una persona ingresa a una instalación determinada con un arma. Se integra con cualquier número de sistemas de vigilancia de circuito cerrado. Pero los algoritmos de aprendizaje automático no solo salen de una caja sabiendo cómo reconocer un arma de fuego más de lo que un perro antidrogas llega del criador, sabiendo la diferencia entre la marihuana y el orégano. Para enseñar el algoritmo, un equipo de la compañía aparece en la ubicación y procede a realizar simulacros de ataques. Lentamente, el algoritmo comienza a aprender cómo se ve una pistola en ese ajuste específico, dependiendo de la luz, los ángulos y otras condiciones. Actualmente están trabajando con las Escuelas de la Ciudad de Nueva York y tienen un contrato con la Aduana y la Patrulla Fronteriza de los Estados Unidos, pero aún no están desplegados en la frontera, dijo Kenny Gregory, un ingeniero de software de la compañía.

La detección automática de armas de fuego es una solución a un problema creciente que no tiene una cura política clara: frenar los tiroteos masivos y la violencia con armas de fuego. Si bien algunas encuestas muestran que el 70 por ciento de los estadounidenses apoyan las leyes de armas más estrictas, ese número es mucho más bajo, alrededor del 31 por ciento, entre los conservadores. Y así, el debate político, aunque ardiente, se ha estancado. Los algoritmos de detección de armas que alertan al personal de seguridad cuando llega una persona armada podrían reducir el número de víctimas, aunque probablemente no tanto como si no hubiera un tirador armado en primer lugar.

Es un indicador predictivo de violencia potencial, en lugar de un indicador rezagado, como el reconocimiento facial, y lleva menos carga política. Cada vez más, las ciudades y los departamentos de policía están experimentando con el reconocimiento facial para detectar la presencia de sospechosos en tiempo real. Se están reuniendo con una fuerte resistencia de los defensores de la privacidad en San Francisco, donde algunos legisladores están tratando de bloquear el despliegue, y en otros lugares.

"La servidumbre digital en la que vivimos no estaba en los planes de los que crearon Internet y las redes"

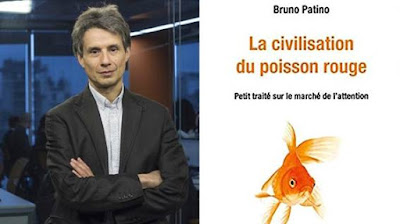

El periodista y ensayista francés acaba de publicar un nuevo libro, "La civilización del pez rojo", en el que describe lo que llama "economía de la atención" o la lógica "salvaje" de acumulación en la cual se basan Facebook y otras plataformas para mantenernos frente a las pantallas el mayor tiempo posible

El periodista y ensayista Bruno Patino y su último libro: La civilización del pez rojo. Pequeño tratado sobre la economía de la atención"

"Somos pececillos rojos, encerrados en la pecera de nuestras pantallas, sometidos al carrousel de nuestras alertas y de nuestros mensajes instantáneos", escribió Bruno Patino en su último libro, titulado La civilización del pez rojo. Pequeño tratado sobre la economía de la atención (Grasset, 2019).

Director editorial de la cadena cultural franco-alemana ARTE y de la Escuela de Periodismo de la muy prestigiosa SciencesPo, Bruno Patino tiene detrás de sí una larga carrera en medios, tanto en prensa escrita, como en radio, TV e Internet.

Patino es un entusiasta de la red pero al mismo tiempo un profeta de sus peligros. Considera que la adicción que hemos desarrollado a nuestros celulares y a nuestras pantallas no es una inexorabilidad sino el resultado de un modelo de negocios que obliga a las redes a permanentemente diseñar instrumentos para atraer nuestra atención por más tiempo.

Luego de sufrir algunos cuestionamientos, Facebook, por ejemplo, intenta mostrar mayor cuidado en lo que hace a la seguridad de nuestros datos, pero no ha modificado su lógica adictiva. Algo que Patino cree que sucederá, más tarde o más temprano, porque así lo exigirán las sociedades.

En su libro, que espera pronto sea editado en español -idioma que habla muy bien y que era el de su padre-, Patino habla de los "arrepentidos" como Tim Berners Lee, "inventor" de la web, que hoy intenta crear una contra-Internet para "aniquilar su creación primaria". "La utopía, sin embargo, era bella, la de unir en una comunión de iguales", a gente muy dispar a lo largo y ancho del mundo.

En charla telefónica con Infobae, afirma sin embargo su optimismo: en un futuro sabremos poner límites y diremos: "Por supuesto que no se utiliza el celular en las escuelas, no se lo mira cuando estamos almorzando en familia, no lo miro cuando estoy con mi pareja".

— En su último libro, de reciente aparición, usted habla de servidumbre digital y de economía de la atención, ¿son sinónimos?

— Más o menos. En realidad el libro habla de nuestra dependencia de las pantallas del móvil, de las redes sociales y de algunas aplicaciones, el libro muestra cómo funciona esa dependencia, hasta qué nivel llega y cuáles son las patologías que estamos desarrollando. Pero trata de explicarlo no como el resultado de la tecnología en sí, sino como el resultado de la aplicación de un modelo económico determinado.

— La economía de la atención.

— Claro, la dependencia individual y, digamos, esta concentración colectiva y social son los resultados de una economía de la atención desenfrenada, sin límites. Trato de mostrar que eso es producto de un modelo económico, y que ese modelo económico no estaba previsto al inicio de esas aplicaciones, pero que éstas poco a poco adoptaron el modelo económico basado en la publicidad y basado por lo tanto en el tiempo que pasamos en esas aplicaciones. Entonces cuando tu modelo económico depende del tiempo que la gente pasa sobre las aplicaciones el desafío es tratar de captar, de conquistar la atención, incluso sobre momentos que tú dedicas a otra cosa. Y para captar esa atención tienes que desarrollar o utilizar instrumentos basados en las neurociencias que en realidad generan una relación de dependencia entre el usuario y la pantalla o la aplicación. Esa economía de la atención, por el momento desatada, nos cambia la vida. Trato de mostrar en mi libro que hay una lógica en esa relación de dependencia porque desarrollar el volumen de negocios de esos modelos implica poder establecer una relación en la cual nosotros no tenemos una libertad total frente a nuestras pantallas.

— ¿Pero es posible evitarlo? ¿Pueden las redes desarrollarse si no es con una lógica económica?

— Por supuesto que tienen que tener una lógica económica. Pero mi teoría es que dentro de 10 años, cuando miremos hacia atrás, hacia el momento que estamos viviendo, nos estaremos diciendo dos cosas: primero que fue el período de la economía digital salvaje, como hubo una época del capitalismo salvaje, y segundo que fue un momento en que no actuamos de modo responsable frente a las consecuencias en términos de salud mental de esos instrumentos. Y no estoy diciendo que haya que acabar con todo eso, solamente estoy tratando de instalar la idea de que debemos poner límites. Si se compara con el negocio de los cigarrillos o del alcohol, vemos que se han puesto ciertos límites en la comercialización de esos productos y todo el mundo considera normal tener algunos límites. Entonces no estoy diciendo que haya que acabar con la economía de la atención, sólo que hay que ponerle un límite a esa economía de la atención. Límites individuales, que pasan por la educación, por temporadas en las cuales se imponen otras conexiones, no estar en esas redes sociales, pero también límites colectivos. Así como se ha puesto límites a muchos mercados económicos, la economía de la atención también tendrá límites. Tal vez yo sea demasiado optimista pero yo estoy casi seguro de que dentro de 10 años estaremos mirando ese período del principio de esa economía digital como uno en el que no tuvimos en principio en claro las consecuencias que traería.

— Sería como la etapa de la acumulación primitiva del capital.

— Exactamente, absolutamente. Como un período primitivo de la economía digital de la atención en el cual se podían utilizar los datos personales para captar la atención incluso en espacios de tiempo que nosotros consagramos a otras cosas. Es eso lo que estoy diciendo y dando muchos ejemplos de nuestra vida cotidiana y de las patologías que hemos desarrollado frente a esos instrumentos.

— Usted compara nuestra conducta ante las redes, en especial la de los millennials, con la del pez rojo en la pecera, por el escaso tiempo de atención que tienen, 9 segundos.

— Son estudios. Esto lo recojo de una reunión que tuvimos con Google en Madrid en la cual habían medido el tiempo de atención del pez rojo que era de 8 segundos y decían -lo presentaban como un desafío-, "fíjense que los millennials ahora tienen un tiempo de atención de 9 segundos". Y Google hablaba de lo difícil que era captar la atención de gente que tiene un tiempo de atención de 9 segundos. Lo que uno vive como un desastre, lo que a uno le hace pensar "a eso hemos llegado", para Google es un desafío. La idea del libro viene de allí.

— Pero esa atención dispersa y tan limitada es impuesta también por las propias redes. Con su constante bombardeo.

— Exactamente. Y cuanto más bombardeo, más reducen el tiempo de atención y más difícil todavía es captar nuestra atención; entonces más tienen que bombardear. Es un círculo vicioso porque el modelo económico está basado en la economía de la atención, entonces todos están compitiendo por esa atención. Por eso nos están solicitando a cada momento, a cada minuto del día. Más lo hacen y más se reduce nuestro tiempo de atención. Más se reduce nuestro tiempo de atención y más nos bombardean de solicitaciones para intentar captar esa atención cada vez más y más difícil de captar. Y el círculo vicioso produce esa dependencia y esa pérdida de control, del dominio que podemos tener sobre nuestro tiempo personal.

— Usted cita también estudios que dicen que más de 30 minutos en las redes, en la pantalla, ya es nocivo para la salud. ¿No depende también de lo que uno esté haciendo en esos 30 minutos? Se puede estar concentrado en una sola cosa durante ese tiempo, por ejemplo.

— Sí, pero el estudio no decía "frente a las pantallas", sino que se refería a más de 30 minutos en las redes sociales. Al tiempo que nosotros pasamos en las redes sociales, no apunta a internet o a la conexión; aquí estamos hablando de un tipo de servicio digital, no de todo el ámbito digital, de todo el universo digital.

— ¿Cree que Facebook se está reformando luego de los cuestionamientos que recibió por el uso de la big data?

— Están tratando de cambiar pero por el momento sólo en dos ámbitos: primero, en el de la seguridad de datos; muchos tienen dudas acerca de esto pero por lo menos lo han enunciado. Habrá que ver después si lo hacen verdaderamente… El segundo capítulo es el de tratar de suprimir todas las cuentas falsas, las fake accounts; dicen que están suprimiendo un millón de cuentas falsas por día.

— ¿Y en qué no estarían cambiando?

— Lo que no están cambiando para nada es la manera en la cual el modelo económico se desempeña en la red, esa economía de la atención sin límite no la están cambiando para nada. Dicen que lo están haciendo pero nunca han tenido ingresos publicitarios tan fuertes; están presentando al mismo tiempo resultados en términos de publicidad que son históricamente altos.

— O sea, el modelo adictivo de Facebook sigue igual.

— El modelo adictivo sigue absolutamente igual y no creo que la auto regulación pueda funcionar. Ninguna empresa en el mundo decide por sí misma limitar la eficiencia de su modelo económico. Sin leyes, usted puede estar segura de que los que fabrican alcohol hoy estarían vendiendo alcohol a los niños. No se puede pedir a una compañía que decida por sí misma limitar su capacidad de aumentar sus ganancias. Entonces si en un momento u otro, y ese es el propósito del libro, nosotros como colectividad llegamos a concluir que es absolutamente urgente y absolutamente importante limitar la capacidad adictiva de la economía de la atención, eso no se va a hacer por sí solo, eso va a requerir movilización. Que llegue el momento dependerá de los países, de las discusiones con las plataformas, de la ley e incluso de asociaciones de usuarios, pero en un momento u otro esto va a tener que ser motivo de una negociación que no se va a generar por sí misma.

— O sea que en definitiva depende de la política.

— Exactamente. Primero se necesita generar una especie de concientización colectiva y un esquema político de ese alto nivel, que me parece muy necesario.

Bruno Patino estuvo en Buenos Aires en 2018 para participar de la Noche de la Filosofía

— ¿Ve que exista una consciencia en su país, por ejemplo, y al menos a nivel de la dirigencia política, sobre estos temas?

— Creo que la sociedad está adelantada respecto de los políticos, porque fíjese que este libro se ha publicado hace un mes y mucha gente dice "esto lo estamos viviendo exactamente así". Estoy absolutamente seguro de que existe la conciencia social de que algo no funciona bien respecto a esa dependencia que tenemos de las pantallas. La conciencia colectiva o social está muy adelantada comparada con la conciencia política. En mi país por lo menos hay una obsesión frente al tema de la fiscalidad de estas compañías pero no la hay todavía en cuanto a los impactos sobre nuestra vida personal, nuestra salud mental y nuestra vida social, colectiva. Creo que la sociedad tiene cierto adelanto frente al mundo político respecto a estos temas.

— En su libro usted habla de los "arrepentidos", esos que fueron pioneros de Internet y las redes y hoy están volcados a tratar de poner un freno a lo que desencadenaron. Un poco me hizo pensar en el que inventó la dinamita y después el Premio Nobel de la Paz.

— Es una muy buena comparación porque de eso estamos hablando, de que la servidumbre digital en la que estamos no estaba en los planes de aquellos creadores, de que esos ingenieros que tuvieron responsabilidades estelares en Silicon Valley y que ahora dicen nuestra creación se nos escapó de las manos, tiene consecuencias que no habíamos previsto, y ahora estamos trabajando para cambiar todo este ámbito creado. Tratan de crear de otras plataformas pero muchos de ellos también están trabajando, investigando, para revelar, para dar a conocer la naturaleza de los algoritmos de Facebook a fin de presionar por un cambio. Y, reitero, no hablan de un cambio absoluto de modelo económico sino que poner algunos límites. Y de eso estoy hablando yo también: no digo que haya que cerrar Facebook, cerrar todo, no se trata de eso sino de que en algún momento la sociedad tiene que poner algunos límites.

— La humanidad se enfrenta siempre a estos nuevos descubrimientos que cambian la vida; la televisión, por ejemplo, también generó reacciones. A veces, en reacción a la tecnificación, alguna gente quiere volver al campo, aislarse, volver a la vida primitiva…

— Eso es imposible. Pero en segundo lugar, internet, la red, también nos está aportando miles de cosas absolutamente positivas. Lo único que estoy diciendo es pongamos algunos límites para que podamos aprovechar esas oportunidades increíbles que nos trae internet.

— Usted pone esperanza en el tema de la educación, para crear conciencia de esta adicción y prevenirla. Pero en este momento el debate es si hay que usar o no el smartphone en la escuela, por ejemplo. ¿Usted qué opina al respecto?

— Estoy seguro, nuevamente, de que dentro de unos años, con toda evidencia vamos a decir "pero por supuesto que no se utiliza el celular en las escuelas", "por supuesto que no se mira el celular cuando estamos almorzando o cenando en familia", "por supuesto que no miro mi celular cuando estoy con mi pareja", etcétera. Estoy totalmente a favor de que en determinados momentos y en determinados lugares no se permita la conexión.

Mientras tanto en EE.UU...

San Francisco, primera

ciudad de EE.UU. que prohíbe el reconocimiento facial por la Policía y el

Gobierno

May 15,

2019

Foto: Pixabay

Por RT

Además, las agencias gubernamentales tendrán que obtener la aprobación

de la Junta de Supervisores de la ciudad antes de comprar tecnología de vigilancia,

así como revelar públicamente su uso previsto.

San Francisco es desde este martes la primera ciudad de EE.UU. que

prohíbe el uso de la tecnología de reconocimiento facial por parte de la

Policía y de otras agencias gubernamentales municipales.

La medida, que fue aprobada por la Junta de Supervisores de la ciudad

con ocho votos a favor y uno en contra, tendrá que ser sometida a una segunda

votación obligatoria la próxima semana, lo que se ve como una formalidad, según

medios locales.

La prohibición del reconocimiento facial forma parte de un paquete de

reglas más amplio que requerirá también que las agencias obtengan la aprobación

de la junta antes de comprar tecnología de vigilancia y que revelen

públicamente su uso previsto.

“Incompatible con una democracia

saludable”

“Con esta votación, San Francisco ha declarado que la tecnología de

vigilancia facial es incompatible con una democracia saludable, y que los

residentes merecen tener una voz en las decisiones sobre la vigilancia de alta

tecnología”, indicó Matt Cagle, de la Unión Estadounidense por las Libertades

Civiles.

Por su parte, el supervisor Aaron Peskin, el legislador que presentó el

proyecto de ley, explicó que su objetivo “no es deshacerse de la

tecnología de vigilancia”, sino que el Gobierno y la sociedad “sepan cómo se

usa esa tecnología”.

La Policía estadounidense ha venido utilizando el reconocimiento facial

para combatir el crimen e identificar a sospechosos. Sin embargo, los críticos

afirman que esta tecnología se ha convertido en una herramienta peligrosa que

viola la privacidad de las personas y, además, es propensa a los errores y

sesgos.

De hecho, algunos estudios han revelado

que esta tecnología podría ser menos precisa a la hora

de identificar a las personas de color.

No hay comentarios.:

Publicar un comentario